Что такое ковариация простыми словами

КОВАРИАЦИЯ

— числовая характеристика совместного распределения двух случайных величин, равная математич. ожиданию произведения отклонений случайных величин от их математич. ожиданий. К. определяется для случайных величин Х 1 и Х 2 с конечными дисперсиями и обычно обозначается cov (X1, Х 2). Таким образом,

при этом cov ( Х 1, X2)=cov(X2, X1);cov (X, Х)=DХ. К. естественным образом появляется в выражении для дисперсии суммы случайных величин

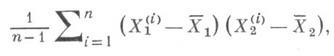

Если величины Х 1 и Х 2 независимы, то cov (X1, X2)=0. К. служит характеристикой взаимозависимости случайных величин, с помощью К. определяется корреляции коэффициент. В математич. статистике оценкой К. служит выборочная К., вычисляемая по формуле

Смотреть что такое «КОВАРИАЦИЯ» в других словарях:

КОВАРИАЦИЯ — (covariance) Показатель степени связи между значениями двух случайных переменных величин. Если х и у – переменные величины со средними значениями μх и μy, a i меняется от 1 до N, ковариация х и у определяется как cov(x, у)=Σi(xi–μx)(yi–μy)/… … Экономический словарь

ковариация — соизменимость Словарь русских синонимов. ковариация сущ., кол во синонимов: 2 • автоковариация (1) • … Словарь синонимов

КОВАРИАЦИЯ — смешанный нейтральный момент второго порядка случайных величин X и Y. К. указывает на наличие линейной зависимости между случайными величинами X и Y. r=Е(Х ЕХ)(Y EY), где ЕХ математическое ожидание Х. коэф. корреляции, DX дисперсия X. К.… … Геологическая энциклопедия

ковариация — и, ж. covariation. мат. В биометрии: сопряженная изменчивость двух признаков. Крысин 1998. Лекс. СИС 1979: ковариа/ция … Исторический словарь галлицизмов русского языка

Ковариация — [covariance] см. Корреляция … Экономико-математический словарь

КОВАРИАЦИЯ — Взаимозависимое совместное изменение двух и более признаков экономического процесса Словарь бизнес терминов. Академик.ру. 2001 … Словарь бизнес-терминов

ковариация — — [http://www.iks media.ru/glossary/index.html?glossid=2400324] Тематики электросвязь, основные понятия EN covariance … Справочник технического переводчика

Ковариация — * каварыяцыя * covariation сопряженная изменчивость; совместное изменение двух признаков … Генетика. Энциклопедический словарь

Ковариация — (корреляционный момент, ковариационный момент) в теории вероятностей и математической статистике мера линейной зависимости двух случайных величин. Содержание 1 Определение 2 Ковариация выборок … Википедия

ковариация — 3.3 ковариация (covariance): Мера статистической зависимости двух наблюдаемых величин, которые могут быть рассмотрены как случайные переменные. Примечание Две наблюдаемые величины имеют отличную от нуля ковариацию, если они коррелированны, т.е.… … Словарь-справочник терминов нормативно-технической документации

Дисперсия и ковариация: что это такое и в чем разница?

Здравствуйте, уважаемые читатели проекта Тюлягин! Сегодня речь пойдет о дисперсии и ковариации, двух на первый взгляд сложных понятий. Однако при более близком рассмотрении вы поймете что в них нет ничего сложного. Эти два термина чаще всего можно встретить в математике и статистике, однако они также используются в финансах и инвестициях. Об этом и поговорим далее в статье.

Содержание статьи:

Что такое дисперсия и ковариация

Дисперсия и ковариация — математические термины, часто используемые в статистике и теории вероятностей. Дисперсия это разброс набора данных вокруг его среднего значения, в то время как ковариация это мера направленного отношения между двумя случайными величинами.

В дополнение к их общему использованию в статистике, оба этих термина имеют также определенные значения для инвесторов, относящиеся к измерениям, проводимым на фондовом рынке, и распределению активов, оба из которых указаны ниже.

Дисперсия простыми словами

Дисперсия используется в статистике для описания разброса между набором данных от его среднего значения. Она рассчитывается путем нахождения взвешенного по вероятности среднего квадрата отклонений от ожидаемого значения. Таким образом, чем больше дисперсия, тем больше расстояние между числами в наборе и средним значением. И наоборот, меньшая дисперсия означает, что числа в наборе ближе к среднему.

Наряду со статистическим определением термин дисперсия также может использоваться в финансовом контексте. Многие биржевые эксперты и финансовые консультанты используют дисперсию акции для измерения ее волатильности. Возможность выразить, насколько далеко стоимость данной акции может отклониться от среднего значения, в одном числе — очень полезный индикатор того, насколько велик риск, с которым связана конкретная акция. Акция с более высокой дисперсией обычно сопряжена с большим риском и потенциалом для более высокой или более низкой доходности, в то время как акция с меньшей дисперсией может быть менее рискованной, что означает, что она будет иметь среднюю доходность.

Ковариация простыми словами

Ковариация — это мера того, как две случайные величины изменятся при сравнении друг с другом. Однако в финансовом или инвестиционном контексте термин ковариация описывает доходность двух разных инвестиций за период времени по сравнению с разными переменными. Эти активы обычно представляют собой рыночные ценные бумаги в портфеле инвестора, например акции.

Положительная ковариация означает, что доходность обоих инвестиций имеет тенденцию одновременно увеличиваться или уменьшаться в стоимости. С другой стороны, обратная или отрицательная ковариация означает, что доходности будут отдаляться друг от друга. Так, когда один актив поднимается, другой актив падает.

Ковариация может измерять движения двух переменных, но не указывает на степень, в которой эти две переменные изменяются по отношению друг к другу.

Ковариацию также можно использовать как инструмент для диверсификации портфеля инвестора. Для этого управляющий инвестиционным портфелем должен искать инвестиции, которые имеют отрицательную ковариацию друг с другом. Это означает, что когда доходность одного актива падает, доходность другого (связанного) актива повышается. Таким образом, покупка акций с отрицательной ковариацией — отличный способ минимизировать риск портфеля. Можно ожидать, что экстремальные пики и спады динамики акций уравновесят друг друга, что приведет к более стабильной норме доходности на протяжении многих лет.

Резюме

А на этом сегодня все про дисперсию и ковариацию, как видите это не так и сложно. Надеюсь статья была для вас полезной и интересной. Делитесь статьей в социальных сетях и мессенджерах и добавляйте сайт в закладки. Успехов и до новых встреч на страницах проекта Тюлягин!

Корреляция, ковариация и девиация (часть 3)

В первой части показано, как на основе матрицы расстояний между элементами получить матрицу Грина. Ее спектр образует собственную систему координат множества, центром которой является центроид набора. Во второй рассмотрены спектры простых геометрических наборов.

В данной статье покажем, что матрица Грина и матрица корреляции — суть одно и то же.

7. Векторизация и нормирование одномерных координат

Пусть значения некой характеристики элементов заданы рядом чисел . Для того, чтобы данный набор можно было сравнивать с другими характеристиками, необходимо его векторизовать и обезразмерить (нормировать).

Для векторизации находим центр (среднее) значений

и строим новый набор как разность между исходными числами и их центроидом (средним):

Получили вектор. Основной признак векторов состоит в том, что сумма их координат равна нулю. Далее нормируем вектор, — приведем сумму квадратов его координат к 1. Для выполнения данной операции нам нужно вычислить эту сумму (точнее среднее):

Теперь можно построить ССК исходного набора как совокупность собственного числа S и нормированных координат вектора:

Квадраты расстояний между точками исходного набора определяются как разности квадратов компонент собственного вектора, умноженные на собственное число. Обратим внимание на то, что собственное число S оказалось равно дисперсии исходного набора (7.3).

Итак, для любого набора чисел можно определить собственную систему координат, то есть выделить значение собственного числа (она же дисперсия) и рассчитать координаты собственного вектора путем векторизации и нормирования исходного набора чисел. Круто.

Упражнение для тех, кто любит «щупать руками». Построить ССК для набора <1, 2, 3, 4>.

8. Векторизация и ортонормирование многомерных координат

Что, если вместо набора чисел нам задан набор векторов — пар, троек и прочих размерностей чисел. То есть точка (узел) задается не одной координатой, а несколькими. Как в этом случае построить ССК? Стандартный путь следующий.

Введем обозначение характеристик (компонент) набора. Нам заданы точки (элементы) и каждой точке соответствует числовое значение характеристики

. Обращаем внимание, что второй индекс

— это номер характеристики (столбцы матрицы), а первый индекс

— номер точки (элемента) набора (строки матрицы).

Далее векторизуем характеристики. То есть для каждой находим центроид (среднее значение) и вычитаем его из значения характеристики:

Получили матрицу координат векторов (МКВ) .

Следующим шагом как будто бы надо вычислить дисперсию для каждой характеристики и их нормировать. Но хотя таким образом мы действительно получим нормированные векторы, нам-то нужно, чтобы эти векторы были независимыми, то есть ортонормированными. Операция нормирования не поворачивает вектора (а лишь меняет их длину), а нам нужно развернуть векторы перпендикулярно друг другу. Как это сделать?

Правильный (но пока бесполезный) ответ — рассчитать собственные вектора и числа (спектр). Бесполезный потому, что мы не построили матрицу, для которой можно считать спектр. Наша матрица координат векторов (МКВ) не является квадратной — для нее собственные числа не рассчитаешь. Соответственно, надо на основе МКВ построить некую квадратную матрицу. Это можно сделать умножением МКВ на саму себя (возвести в квадрат).

Но тут — внимание! Неквадратную матрицу можно возвести в квадрат двумя способами — умножением исходной на транспонированную. И наоборот — умножением транспонированной на исходную. Размерность и смысл двух полученных матриц — разный.

Умножая МКВ на транспонированную, мы получаем матрицу корреляции:

Из данного определения (есть и другие) следует, что элементы матрицы корреляции являются скалярными произведениями векторов (грамиан на векторах). Значения главной диагонали отражают квадрат длины данных векторов. Значения матрицы не нормированы (обычно их нормируют, но для наших целей этого не нужно). Размерность матрицы корреляции совпадает с количеством исходных точек (векторов).

Теперь переставим перемножаемые в (8.1) матрицы местами и получим матрицу ковариации (опять же опускаем множитель 1/(1-n), которым обычно нормируют значения ковариации):

Здесь результат выражен в характеристиках. Соответственно, размерность матрицы ковариации равна количеству исходных характеристик (компонент). Для двух характеристик матрица ковариации имеет размерность 2×2, для трех — 3×3 и т.д.

Почему важна размерность матриц корреляции и ковариации? Фишка в том, что поскольку матрицы корреляции и ковариации происходят из произведения одного и того же набора векторов, то они имеют один и тот же набор собственных чисел, один и тот же ранг (количество независимых размерностей) матрицы. Как правило, количество векторов (точек) намного превышает количество компонент. Поэтому о ранге матриц судят по размерности матрицы ковариации.

Диагональные элементы ковариации отражают дисперсию компонент. Как мы видели выше, дисперсия и собственные числа тесно связаны. Поэтому можно сказать, что в первом приближении собственные числа матрицы ковариации (а значит, и корреляции) равны диагональным элементам (а если межкомпонентная дисперсия отсутствует, то равны в любом приближении).

Если стоит задача найти просто спектр матриц (собственные числа), то удобнее ее решать для матрицы ковариации, поскольку, как правило, их размерность небольшая. Но если нам необходимо найти еще и собственные вектора (определить собственную систему координат) для исходного набора, то необходимо работать с матрицей корреляции, поскольку именно она отражает скалярное произведение векторов.

Отметим, что метод главных компонент как раз и состоит в расчете спектра матрицы ковариации/корреляции для заданного набора векторных данных. Найденные компоненты спектра располагаются вдоль главных осей эллипсоида данных. Из нашего рассмотрения это вытекает потому, что главные оси — это и есть те оси, дисперсия (разброс) данных по которым максимален, а значит, и максимально значение спектра.

Правда, могут быть и отрицательные дисперсии, и тогда аналогия с эллипсоидом уже не очевидна.

9. Матрица Грина — это матрица корреляции векторов

Рассмотрим теперь ситуацию, когда нам известен не набор чисел, характеризующих точки (элементы), а набор расстояний между точками (причем между всеми). Достаточно ли данной информации для определения ССК (собственной системы координат) набора?

Ответ дан в первой части — да, вполне. Здесь же мы покажем, что построенная по формуле (1.3′) матрица Грина и определенная выше матрица корреляции векторов (8.1) — это одна и та же матрица.

Как такое получилось? Сами в шоке. Чтобы в этом убедиться, надо подставить выражение для элемента матрицы квадратов расстояний

в формулу преобразования девиации:

Отметим, что среднее значение матрицы квадратов расстояний отражает дисперсию исходного набора (при условии, что расстояния в наборе — это сумма квадратов компонент):

Подставляя (9.1) и (9.3) в (9.2), после несложных сокращений приходим к выражению для матрицы корреляции (8.1):

Итак, матрица Грина и матрица корреляции векторов — суть одно и то же. Ранг матрицы корреляции совпадает с рангом матрицы ковариации (количеством характеристик — размерностью пространства). Это обстоятельство позволяет строить спектр и собственную систему координат для исходных точек на основе матрицы расстояний.

Для произвольной матрицы расстояний потенциальный ранг (количество измерений) на единицу меньше количества исходных векторов. Расчет спектра (собственной системы координат) позволяет определить основные (главные) компоненты, влияющие на расстояния между точками (векторами).

Таким образом можно строить собственные координаты элементов либо на основании их характеристик, либо на основании расстояний между ними. Например, можно определить собственные координаты городов по матрице расстояний между ними.

Повторение статистики для начала путешествия по науке о данных

Введение

Предположим, у нас есть диаграмма рассеяния, на которой каждая точка — это человек. На одной оси показан его профессиональный опыт в годах, на другой — доход.

В соответствии с диаграммой справа можно заключить, что между опытом и доходом нет никакой связи, то есть определенный опыт оплачивается по-разному.

Слева, наоборот, между признаками существует четкая линейная зависимость.

Ковариация и корреляция показывают, насколько тесно между собой связаны переменные набора данных.

N.B: в приведенном примере представлен двумерный вид данных (с двумя переменными). На практике статистики используют многомерные данные (со множеством переменных).

Ковариация

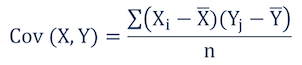

Ковариация — это мера зависимости между двумя или более случайных переменных.

С английского «covariance» = «co» (совместность/соединение) + «variance» (дисперсия). То есть ковариация похожа на дисперсию, но она применяется для сравнения двух переменных, где вместо суммы квадратов, мы получаем сумму векторного произведения.

Дисперсия показывает, насколько определенная переменная отличается от среднего значения, а ковариация — насколько две переменные отличаются друг от друга. Таким образом, можно утверждать следующее:

Ковариация измеряет дисперсию между двумя переменными.

Ковариация может быть отрицательной, положительной и нулевой: положительное значение показывает, что две переменные изменяются в одном направлении (если одна переменная увеличивается, то и вторая тоже увеличивается); отрицательное значение показывает, что две переменные изменяются в разных направлениях (одна увеличивается, вторая уменьшается); нулевая ковариация означает, что они изменяются независимо друг от друга.

Формула

Формулу сложно объяснить, но важно понять, что она означает:

Предположим, что набор данных со случайными переменными представлен в виде вектора. Тогда в прошлом примере у нас есть два вектора для опыта и дохода. Ниже приведен порядок действий:

На втором этапе измеряется угол между двумя векторами. Если угол острый, то переменные тесно связаны между собой.

Ограниченность

Следует отметить, что несмотря на то, что ковариация измеряет зависимость между направлениями двух переменных, она не показывает тесноту этой зависимости.

На практике самая большая проблема с этой мерой заключается в том, что она зависит от используемой единицы измерения. Например, необходимо перевести годы опыта в месяцы. Тогда ковариация будет в 12 раз больше.

В этом случае на помощь приходит корреляция!

Корреляция

Корреляция — одна из наиболее распространенных мер в статистике, описывающая тесноту взаимосвязи между двумя случайными переменными. Она считается нормализованной версией ковариации. Давайте рассмотрим, почему…

Формула

Корреляция (обозначаемая греческой буквой «ро» — ρ) рассчитывается по следующей формуле:

Обратите внимание, что функциональная связь редко встречается на практике, так как две случайные переменные обычно не сопоставляются друг с другом на основе постоянного значения.

Корреляция, равная 0, означает, что между двумя переменными нет линейной зависимости. Тогда может быть отношение x = y².

Ключевые свойства

Корреляция — безразмерная величина, указывающая не только на направление взаимосвязи, но и на ее тесноту (в зависимости от того, насколько большим является абсолютное значение). Единицы измерения исключены из-за того, что ковариацию разделили на среднеквадратическое отклонение.

Напоследок необходимо запомнить, что корреляция не является причинно-следственной связью. Высокая корреляция между двумя случайными переменными просто означает, что они связаны друг с другом, но их взаимоотношение не обязательно должен иметь причинно-следственный характер. Доказать причинно-следственную связь можно только с помощью контролируемых экспериментов, при которых внешние переменные исключаются и эффекты двух данных переменных изолируются.

Ковариация

которая может быть получена из первой формулы, используя свойства математического ожидания. Перечислим основные свойства ковариации.

1. Ковариация случайной величины с самой собой есть ее дисперсия.

2. Ковариация симметрична.

$$cov\left(X,\ Y\right)=cov\left(Y,\ X\right).$$

4. Постоянный множитель можно выносить за знак ковариации.

$$cov\left(cX,\ Y\right)=cov\left(X,\ cY\right)=c\cdot cov\left(X,\ Y\right).$$

5. Ковариация не изменится, если к одной из случайных величин (или двум сразу) прибавить постоянную величину:

$$cov\left(X+c,\ Y\right)=cov\left(X,\ Y+c\right)=cov\left(X+x,\ Y+c\right)=cov\left(X,\ Y\right).$$

9. Дисперсия суммы (разности) случайных величин равна сумме их дисперсий плюс (минус) удвоенная ковариация этих случайных величин:

$$D\left(X\pm Y\right)=D\left(X\right)+D\left(Y\right)\pm 2cov\left(X,\ Y\right).$$

$$M\left(X\right)=\sum^n_

$$M\left(Y\right)=\sum^n_

$$M\left(XY\right)=\sum_

Корреляция

Перечислим основные свойства коэффициента корреляции.

При копировании материала с сайта, обратная ссылка обязательна!