tts что это такое

Tts что это такое

Полезное

Смотреть что такое «TTS» в других словарях:

TTS — is a three letter abbreviation that may refer to: * Text To Speech, see: Speech synthesis * Trouble Ticket System, now known as: Issue tracking system * Tamil Nadu Theological Seminary * Tecno Trolley System World Leader for production of… … Wikipedia

TTS — ist eine Abkürzung für: Audi TTS ist die Sportvariante des Audi TT TTS Tooltechnic Systems AG Co. KG IATA Flughafencode für die Shuttle Landing Facility des Kennedy Space Centers Text to Speech, siehe Sprachsynthese Thales Transportation Systems… … Deutsch Wikipedia

TTS — COMPUTING abbreviation for text to speech * * * TTS UK US adjective IT ► ABBREVIATION for TEXT TO SPEECH(Cf. ↑text to speech) … Financial and business terms

TTS — [Abk. für Text to Speech, dt. »Text zu Sprache«], Multimedia: Sprachsynthese … Universal-Lexikon

TTS — TTS: Abk. für ↑transdermales therapeutisches System … Das Wörterbuch medizinischer Fachausdrücke

TTS — Cette page d’homonymie répertorie les différents sujets et articles partageant un même nom. Sigles d’une seule lettre Sigles de deux lettres > Sigles de trois lettres Sigles de quatre lettres … Wikipédia en Français

TTS — Teletypesetter. * * * TTS (no periods), teletypesetter. * * * abbr. text to speech, a form of speech synthesis used to create a spoken version of the text in an electronic document … Useful english dictionary

TTS — Teletypesetter. * * * … Universalium

TTS — Text To Speech (Computing » General) * Temporary Threshold Shift (Academic & Science » Electronics) * Transdermal Therapeutic System (Medical » Oncology) * Trouble Ticket System (Computing » General) * Tarsal Tunnel Syndrome (Medical »… … Abbreviations dictionary

TTS — tarsal tunnel syndrome; temporary threshold shift; The Tromso Study; through the scope; through the skin; tilt table standing; transdermal therapeutic system; twin transfusion syndrome … Medical dictionary

TTS — • Trouble Ticket System • TeleTypeSetting ( > IEEE Standard Dictionary ) • Temporary Threshold Shift ( > IEEE Standard Dictionary ) • Transistor Transistor logic Schottky barrier ( > IEEE Standard Dictionary ) • Transmission Test Set (… … Acronyms

Обзор мобильных Text-To-Speech движков

В данном обзоре приведена классификация и описаны самые достойные из рода mobile TTS engine.

Я занимаюсь исследованиями в области проектирования интерфейсов мобильных устройств для людей с ограниченными возможностями зрения. Для реализации одного из моих проектов мне потребовался движок генерации голоса с мультиязыковой поддержкой (как минимум два языка – английский и русский). Это и послужило причиной поиска синтезатора речи.

Коммерческие движки

SVOX Mobile TTS

Цена: n/a

Языки: 26, включая русский

Субъективная оценка качества звучания: высокое

Мобильные ОС: Android, Symbian, Windows CE/Windows Mobile, BREW

Возможность разработки коммерческих продуктов: есть

Компания SVOX имеет наиболее «вкусный» с технической точки зрения продукт — SVOX Mobile TTS. Однако, поскольку компания работает в основном в B2B сегменте, на мои два письма с запросом цены они так и не ответили.

Acapela TTS

Цена: 2800€ плюс так называемая run-time license, за которую в самом лучшем случае придется платить по 49€ за каждое распространенное приложение

Языки: 23, включая русский

Субъективная оценка качества звучания: высокое

Мобильные ОС: Symbian, Windows CE/Windows Mobile, Embedded Linux, iOS

Возможность разработки коммерческих продуктов: есть

Сотрудники Acapela Group оказались намного более общительными и ответили буквально через полчаса после заполнения вот этой заявки.

Цена, указанная в шапке, относится к таким операционным системам как Windows Mobile и Symbian, однако бизнес-модель Acapela разнится в зависимости от выбранной ОС. К примеру, наиболее сильно они продвигают направление iOS, для которого сделан отдельный сайт. Там можно зарегистрироваться и бесплатно получить evaluation версию их движка. Цена голого SDK для бывшей iPhone OS составляет 250€. Так же с каждого проданного Вами в App Store приложения снимаются немалые проценты.

Отмечу, что Acapela предоставляет «облачный» синтез речи, а так-же портирование SDK под любую платформу.

Loquendo Embedded TTS

Цена: 3000€ плюс проценты с каждого проданного Вами мобильного приложения

Языки: 26, включая русский

Субъективная оценка качества звучания: высокое

Мобильные ОС: Android, Symbian, Windows CE/Windows Mobile, Embedded Linux, iOS, Maemo, Moblin, MeeGo, PalmOS

Возможность разработки коммерческих продуктов: есть

Движок Loquendo обладает специальными тегами, позволяющими делать речь более естественной, подмешивая такие не совсем «речевые» фишки как кашель, смех и прочее.

Их движок отвечает спецификации SSML 1.0 рекомендованной W3C.

Sakrament TTS

Цена: 1500€ для одной ОС, при покупке пакета сразу для двух языков предоставляется скидка в размере 25%, что составляет 2250€

Языки: английский, русский

Субъективная оценка качества звучания: среднее

Мобильные ОС: Symbian, Windows Mobile

Возможность разработки коммерческих продуктов: есть

Качества синтеза речи Sakrament TTS вполне достаточно, что бы озвучивать короткие фразы типа номеров телефонов или названий приложений. Описание всех версий SDK можно получить здесь.

Свободные движки

Flite

Цена: нет

Языки: английский плюс возможность компиляции языков FestVox

Субъективная оценка качества звучания: низкое

Мобильные ОС: Android, Windows CE/Windows Mobile, iOS, PalmOS

Возможность разработки коммерческих продуктов: есть (CMU licence)

В мире настольных систем хорошо известен синтезатор речи Festival. Он имеет порт под названием Flite для мобильных устройств и встраиваемых систем, который распространяется под их собственной X11-like лицензией, позволяющей свободно распространять данное ПО кому угодно, а так же строить на его основе как коммерческие, так и свободные приложения. Существуют порты для Windows CE/Windows Mobile, PalmOS, Android и iOS.

eSpeak

Цена: нет

Языки: 39, включая русский

Субъективная оценка качества звучания: среднее

Мобильные ОС: Android, Windows CE/Windows Mobile

Возможность разработки коммерческих продуктов: нет (GNU GPL)

Инструкция для компиляции движка под WM включена в дистрибутив, однако на этой платформе eSpeak имеет одно существенное ограничение – генерация голоса возможна только в WAV файл. Собранный TTS engine для Windows Mobile можно получить здесь.

eSpeak портирован на Android. Самый простой способ его попробовать — это установить из Android Market’а приложение TTS Service Extended, которое позволяет переключаться между встроенным движком и eSpeak. Данный TTS движок распространяется на условиях GNU GPL.

Встроенные решения

Встроенные решения присутствуют только в Symbian и Android. По какой-то неизвестной причине Microsoft лишила свою мобильную ОС соответствующего программного интерфейса (MS SAPI).

Symbian

Цена: нет

Языки: английский

Субъективная оценка качества звучания: крайне низкое

Возможность разработки коммерческих продуктов: есть

Встроенный TTS от Symbian Foundation скрывается в классе CMdaAudioPlayerUtility. Хотя в его документации ничего об этом не сказано, он все же позволяет синтезировать речь. К сожалению, русский язык не поддерживается. Качество генерации английской речи очень низкое. Без подготовки довольно трудно понять, что именно он произнес.

Дополнительные языковые пакеты можно загрузить здесь, однако список поддерживаемых телефонов крайне мал. Установка пакетов для русского языка на устройство под управлением Symbain OS S60 5th не дала ожидаемых результатов, встроенный TTS так и не заговорил по-русски.

Отмечу, что имеется достаточно удобное расширение API под названием NSS TTS Utility API, описание которого можно найти здесь.

Android

Цена: нет

Языки: английский, французский, немецкий, итальянский, испанский

Субъективная оценка качества звучания: среднее

Возможность разработки коммерческих продуктов: есть

Встроенная функциональность синтеза речи в Android доступна с версии 1.6. Прекрасное введение в тему можно найти в блоге разработчиков. Android TTS API является не чем иным, как оберткой над SVOX Pico, русский язык, которым, к сожалению, не поддерживается.

Заключение

Выводы каждому придется делать в зависимости от требований к разрабатываемому продукту. Для коммерческих решений крайне важно качество синтеза речи, поэтому выбирать стоит из двух движков – Acapela TTS и Loquendo Embedded TTS. При выборе движка для open source проекта крайне важную роль будет играть список целевых ОС.

Лично для себя я выбрал eSpeak, поскольку мой проект академического толка и я могу себе позволить использование продукта лицензированного по GNU GPL.

7 способов использовать синтез речи в обучении

Равные возможности обучения. Для студентов с дислексией, изучающих родной или иностранный язык, может стать трудностью создание инклюзивной школьной среды. Доказано, что TTS улучшает успеваемость среди таких учащихся. Использование технологии также сэкономит средства на создании индивидуальных программ обучения, так как TTS более эффективное решение для проблем с чтением.

Упрощение процесса чтения. Для большинства учеников чтение — утомительный процесс. Но его можно упростить с помощью технологии. Например, когда студенту надоело читать, то он может надеть наушники и продолжить с помощью TTS. Исследования показывают, что технология помогает сконцентрироваться на содержании материала, а не процессе чтения, что улучшает его понимание.

Подставьте в блок любой текст и послушайте, как он звучит. В демо его можно прочитать с разной эмоциональной окраской, а в полной — использовать любые голоса. Представьте, что достаточно нажать на кнопку «Озвучить» в электронной книге или учебники, тем самым упростив процесс чтения.

TTS помогает работать с текстом. Часто люди ленятся вычитывать написанный текст или просто чувствуют себя неловко, когда делаю это вслух. Но послушать свои слова бывает полезно: можно заметить пропущенные знаки препинания, опечатки и неблагозвучие.

Виртуальный HR-ассистент. На его можно переложить задачи по адаптации новых сотрудников: разработать программу обучения, добавить базу знаний и FAQ. Так даже старый сотрудник может без стеснения задать вопросы.

Интерактивное обучение. Вместе с системой компьютерного зрения TTS можно превратить в виртуального наставника, который будет обучать работе с оборудованием. Например, давать подсказки по ремонту автомобиля или учить жарить котлеты.

Платформы с виртуальной реальностью, искусственным интеллектом и распознаванием речи могут обеспечить сотрудникам персонализированный подход. Например, сотрудники отделов продаж могут обучаться на виртуальных клиентах и общаться с машиной как с реальным человеком. Это поможет им подготовиться ко встречам с настоящими клиентами.

Проверьте себя с помощью нашего теста. Попробуйте угадать, где говорит робот, а где — реальный человек.

Языковая практика. Это важный момент в изучении иностранного языка, потому что таким образом запрекляется материал и запоминается произношение. Но не все могут позволить общение с носителем, поездку в языковой лагерь, а кто-то просто стесняется говорить с другими на иностранном. С помощью разговорных технологий можно снять этот барьер.

Сейчас мы разрабатываем чат-бота, который помогает изучать английский язык. Человек общается с ботом со встроенным GPT-2, он фиксирует неправильное произношение и другие ошибки в речи, а затем выдает отчет и предлагает повторить эти слова.

Развитие грамотности. На планете более 780 млн не умеют читать и писать. В основном это жители Центральной Африки и Западной Азии, где проживает 76% всех неграмотных людей. Системы синтеза и распознавания речи способны сделать для таких людей информацию и обучение доступнее. Мы безвозмездно предоставляем 1% наших мощностей для реализации проектов для малограмотного населения.

Синтез речи (Text To Speech) основан на машинном обучении. Технологию можно использовать для преобразования текста в речь, генерации музыки, речи, создавать устройства с голосовой поддержкой, разработки систем навигации и реализации доступности для людей с нарушениями зрения. Например, с помощью TTS Стивен Хокинг общался с другими людьми.

Распознавание речи (Automatic Speech Recognition) сложнее, чем TTS, потому что нужно преобразовать разговорную речь в неидеальных условиях, где есть побочные шумы, особенности произношения и другие помехи. Чаще всего технология используется в виртуальных помощниках, например, Сири или Алекса.

Понимание естественного языка (Natural Language Understanding) используется с двумя предыдущими технологиями. С ее помощью можно автоматизировать работу колл-центров и служб поддержки, научить общаться ботов и умные устройства.

Lipsync позволяет сопоставить движение губ говорящего или поющего с предварительно записанным голосом, который будут слышать люди. С ее помощью можно «оживить» виртуального ассистента, учителя или игрового персонажа.

GPT-2 — языковая модель, которая обучалась на 8 млн веб-страниц. Она умеет предсказывать следующее слово в тексте, учитывая предыдущий контекст. Модель также распознает текст, отвечает на вопросы и переводит фразы без дополнительного обучения.

BERT — лингвистическая модель от Google, помогающая понимать и обрабатывать текст на естественном языке. Компании ее используют для обучения собственных моделей, а Google — для понимания контекста в поисковых запросах.

Имитация реальности. С помощью технологий можно воссоздать реальные ситуации и диалоги, чтобы отработать конкретные навыки. Например, кто-то хочет подтянуть английский язык перед поездкой, а другой — перед выступление на ИТ-конференции. Одному сотруднику нужно научиться общаться с премиальными клиентами, а другому — отрабатывать клиентский негатив. Для каждого из этих случаев можно создать реальные истории.

И если все это вам кажется неправдоподобным, то это только потому, что вы еще не слышали наших роботов. Послушайте, посмотрите, попробуйте поиграть с настройками нашего демо – и сравните их с голосами наших конкурентов.

Речевые технологии. Часть1. Text-to-Speech: как работает синтез речи

Технологии распознавания и синтеза речи постоянно совершенствуются. Голосовые роботы уже берут на себя большую часть рутинных задач колл-центров, а ИИ способен не только понимать человеческую речь и распознавать эмоции, но и поддерживать разговор. Теперь в процессе общения по телефону отличить робота от человека бывает очень трудно. Все это делает жизнь людей проще, но речевые технологии созданы не для развлечения. Это инструмент бизнеса, который позволяет ему работать более эффективно.

Начнем погружение в речевые технологии с синтеза речи. Рассказываем, что такое технология Text-to-Speech и как она работает.

Что такое синтез речи

Синтез речи или Text-to-Speech (TTS) — технология преобразования текста в речь. Это компьютерное моделирование человеческой речи из текстового представления при помощи методов машинного обучения. Обычно синтез речи используют разработчики для создания голосовых роботов, например, IVR (интерактивный голосовой ответ).

Синтез речи экономит время и деньги бизнеса, так как генерирует звук автоматически и этим избавляет компанию от ручной записи (и перезаписи) аудиофайлов.

Благодаря синтезу речи можно прочитать любой текст голосом, максимально похожим на естественный. Чтобы сделать синтезированную речь натуральной, необходимо отточить ее тембр, плавность звучания, расстановку ударений и пауз, интонацию и другие области.

Для этого используются два подхода:

Как работает Text-to-Speech

Чтобы преобразовать текст в голос, система должна пройти три этапа: преобразовать текст в слова, выполнить фонетическую транскрипцию и преобразовать транскрипцию в речь.

1. Преобразовать текст в слова

Специальный алгоритм должен подготовить текст и преобразовать его в удобный формат для чтения. Проблема в том, что исходный текст помимо слов содержит числа, сокращения, даты и пр. Такие компоненты необходимо расшифровать и записать словами. Затем алгоритм разделяет текст на отдельные фразы, которые потом система прочитает с подходящей интонацией. Для этого при создании фраз робот ориентируется на пунктуацию и устойчивые конструкции в тексте.

2. Выполнить фонетическую транскрипцию

После того, как алгоритм разбил текст на фразы, ему необходимо выполнить фонетическую транскрипцию. Каждое предложение можно произносить по-разному в зависимости от смысла и эмоциональной окраски текста. Более того, даже одно слово может читаться разными способами. Чтобы понять, как произносится каждое слово и где именно ставить ударение, система использует встроенные словари. Если необходимое слово в них отсутствует, компьютер строит транскрипцию самостоятельно, используя академические правила. Если это тоже не помогает, то алгоритм опирается на записи дикторов и определяет, на каких частях слов они делали акценты.

Затем система рассчитывает, сколько в составленной транскрипции фрагментов длиной 25 миллисекунд. Каждый фрагмент она описывает различными параметрами: частью какой фонемы он является, какое место в ней занимает, в какой слог входит эта фонема и др. После этого система воссоздает подходящую интонацию с помощью данных о фразах и предложениях.

Фонема — минимальная единица звукового строя языка.

Преобразовать транскрипцию в речь

Чтобы прочитать подготовленный текст, система использует акустическую модель. Она устанавливает связь между фонемами и звуками, придавая им верную интонацию благодаря машинному обучению. Чтобы что-то сказать, робот использует генератор звуковых волн, в который загружаются все данные о частотных характеристиках фраз, полученные от акустической модели.

Как синтез речи используется в бизнесе

Синтез речи можно применять в следующих областях:

Например, компания KFC настроила автоматическую верификацию заявок HR с помощью Voximplant. HR-департамент KFC загружает в свою CRM-систему список телефонных номеров кандидатов и текст вакансии. Voximplant делает несколько попыток дозвона. После успешного соединения робот спрашивает, интересно ли получить информацию о работе (синтез речи). Если кандидат ответил утвердительно (распознавание речи), робот рассказывает о вакансии и ставит в очередь к сотруднику колл-центра. До начала разговора сотрудник KFC получает информацию о соискателе в текстовом виде.

Например, компания «КЛЮЧАВТО» с помощью Voximplant настроила автоматизированный сбор обратной связи клиентов по итогам покупки автомобиля и прохождения ТО. Робот приветствует клиента по имени и просит оценить ряд критериев по шкале от 1 до 10. Развернутые ответы транскрибируются и сохраняются в текстовом виде.

Решение от Voximplant

Voximplant предоставляет API, позволяющий легко интегрировать функциональность TTS в свое приложение или веб-сайт. Компании используют TTS для обработки входящих и исходящих вызовов, а также для управления голосовыми уведомлениями, при этом не требуется никакого оборудования или сложного программирования.

Voximplant поддерживает TTS на базе таких сервисов, как Amazon Polly, Google WaveNet, Dialogflow, IBM Watson, Яндекс SpeechKit, Tinkoff VoiceKit и Microsoft Azure. WaveNet также используется онлайн-сервисами Google: Google Assistant, Google Search и Google Translate. WaveNet генерирует необработанные аудиосигналы с помощью нейронной сети, обученной на большом количестве речевых образцов. Вся необходимая информация для генерации речи хранится в параметрах модели, а тон голоса можно контролировать с помощью настроек модели.

Особенности решения от Voximplant:

Бизнесу из любой сферы интересен ИИ, который может не просто озвучивать текстовые фрагменты, но и синтезировать их. Все это осуществимо благодаря машинному обучению. Но система синтеза речи должна также уметь подбирать интонацию, правильно расставлять ударения и паузы, различать слова-омографы (например, «замОк» и «зАмок»). Это непростая задача, поэтому для создания полноценной системы синтеза речи помимо компьютера может потребоваться большая команда специалистов.

Высококачественная, легковесная и адаптируемая технология Text-to-Speech с использованием LPCNet

Последние достижения в области глубокого обучения привносят существенные улучшения в развитие систем синтеза речи (далее – TTS). Это происходит благодаря применению более эффективных и быстрых методов изучения голоса и стиля говорящих, а также благодаря синтезу более естественной и качественной речи.

Однако, чтобы этого достичь, большинство систем TTS должны использовать большие и сложные модели нейронных сетей, которые трудно обучить и которые не позволяют синтезировать речь в реальном времени, даже при помощи графических процессоров.

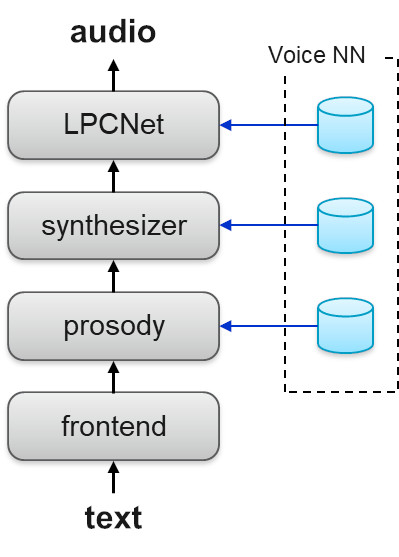

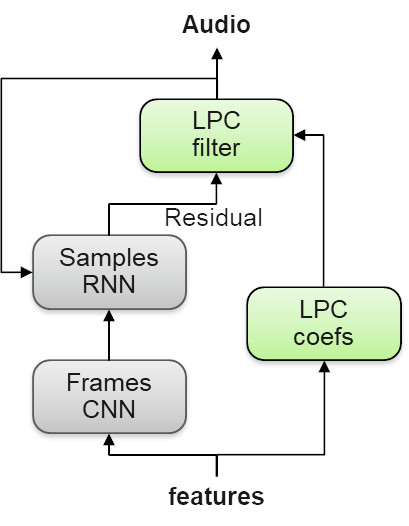

Чтобы решить эти проблемы, наша команда IBM Research AI разработала новый метод нейросетевого синтеза, основанный на модульной архитектуре. Данный метод объединяет три глубокие нейронные сети (deep neural network, далее – DNN) с промежуточной обработкой их выходных сигналов. Мы представили эту работу в нашей статье «Высококачественная, легковесная и адаптируемая TTS технология с использованием LPCNet» на Interspeech 2019. Архитектура TTS легка и может синтезировать высококачественную речь в режиме реального времени. Каждая сеть специализируется на различных аспектах голоса говорящего, что позволяет эффективно обучать любой из компонентов независимо от других.

Схема 1. Системная архитектура TTS

Другое преимущество нашего подхода заключается в том, что после обучения базовых сетей их можно легко адаптировать к новому стилю речи или голосу даже на небольших объемах обучающих данных, например, в целях брендинга и кастомизации.

В процессе синтеза используется интерфейсный модуль для конкретного языка, который преобразует входной текст в последовательность лингвистических признаков. Затем применяются следующие DNN одна за другой:

1. Предсказание просодии

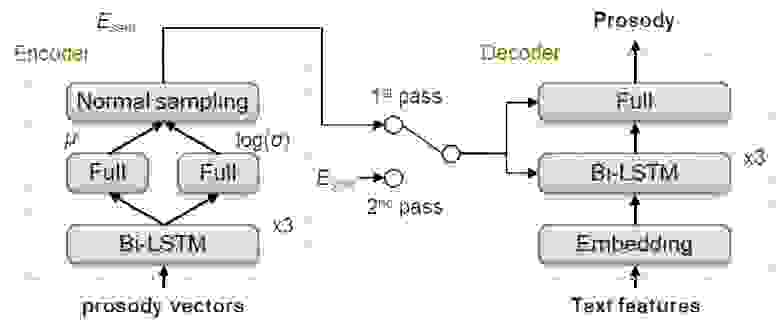

Просодические признаки речи представлены в виде четырехмерного вектора на единицу TTS (примерно одна треть состояний звука по СММ (скрытая марковская модель)), включающего в себя log-duration, начальный и конечный log-pitch, а также log-energy. Эти признаки определяются в процессе обучения, поэтому их можно предсказать по особенностям текста, полученного интерфейсом во время синтеза. Просодия чрезвычайно важна не только для того, чтобы речь звучала естественно и живо, но и для того, чтобы в данных, предназначенных для обучения или адаптации, имелось наиболее полное отражение стиля речи говорящего. Адаптация просодии к голосу диктора основана на вариационном автоэнкодере (Variational Auto Encoder, VAE).

Схема 2. Обучение и переобучение генератора просодии

2. Прогнозирование акустических признаков

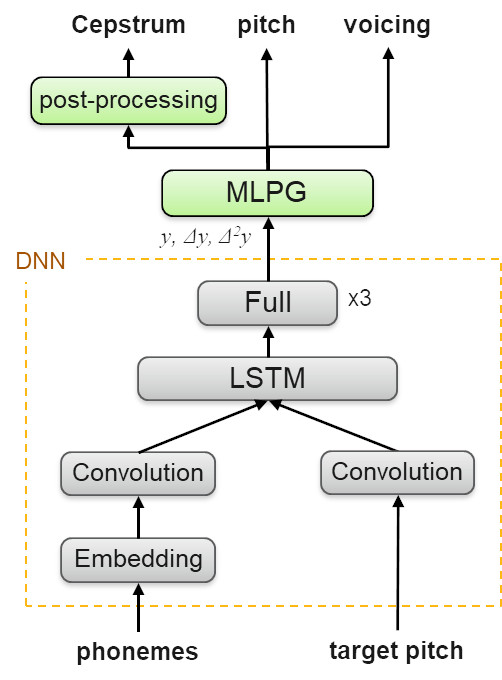

Векторы акустических признаков обеспечивают спектральное представление речи в коротких 10-миллисекундных кадрах, из которых может быть сгенерирован фактический звук. Акустические особенности определяются в процессе обучения, и их можно предсказать по фонетическим меткам и просодии во время синтеза.

Схема 3. Сеть-синтезатор

Созданная модель DNN представляет собой аудиоданные (голос диктора), необходимые для обучения или адаптации. Архитектура модели состоит из сверточных и рекуррентных слоев, предназначенных для извлечения локального контекста и временных зависимостей в последовательности звуков и структуре тона. DNN предсказывает акустические признаки по их первой и второй производной. Затем следует метод максимального правдоподобия и применяются формантные фильтры, которые помогают генерировать речь лучшего звучания.

3. Нейронный вокодер

Нейронный вокодер отвечает за генерацию речи из акустических признаков. Он обучается на образцах естественной речи говорящего, учитывая их соответствующие особенности. Технически мы были первыми, кто использовал новый, легкий, высококачественный нейронный вокодер под названием LPCNet в полностью коммерциализированной системе TTS.

Новизна этого вокодера заключается в том, что он не пытается предсказать сложный речевой сигнал непосредственно с помощью DNN. Вместо этого DNN только прогнозирует менее сложный остаточный сигнал голосового тракта, а затем использует фильтры LPC (Linear Predictive Coding) для преобразования его в окончательный речевой сигнал.

Схема 4. Нейронный вокодер LPCNet

Голосовая адаптация

Адаптация к голосу легко достигается путем переобучения трех сетей на основе небольшого количества аудиоданных целевого диктора. В нашей статье мы представляем результаты адаптационных экспериментов с точки зрения качества речи и ее сходства с истинной речью диктора. На этой странице также приведены примеры адаптации к восьми различным дикторам VCTK (Voice Cloning Toolkit), из которых 4 являются мужчинами и 4 – женщинами.

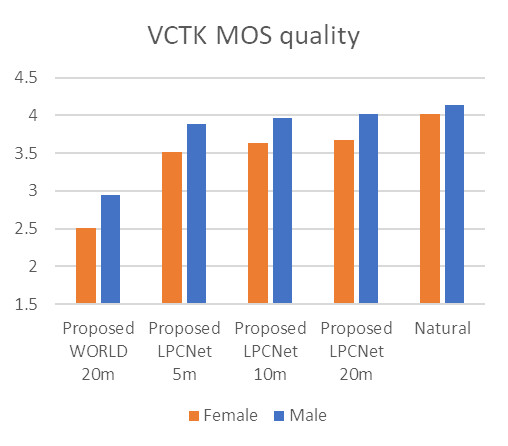

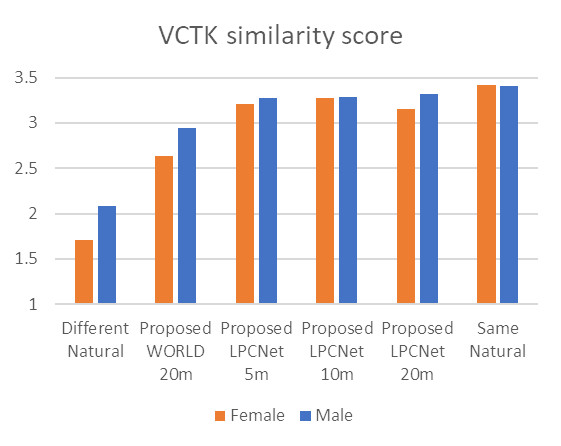

Результаты прослушивания

На рисунке ниже представлены результаты тестов прослушивания синтезированных и естественных образцов речи дикторов VCTK. Значения средней экспертной оценки (Mean Opinion Score, MOS) основываются на анализе слушателями качества речи по шкале от 1 до 5. Сходство между парами образцов оценено слушателями по шкале от 1 до 4.

Мы измерили качество синтезированной речи, а также ее сходство с речью «живых» дикторов, сравнив женские и мужские адаптированные голоса длительностью 5, 10 и 20 минут с естественной речью дикторов.

Результаты испытаний показывают, что мы можем поддерживать как высокое качество, так и высокое сходство с оригиналом даже для голосов, которые были обучены на пятиминутных примерах.

Схема 5. Результаты тестов на качество и сходство

Эта работа была проведена IBM Watson и послужила основой для нового выпуска сервиса IBM Watson TTS с улучшенным качеством голоса (см. голоса «*V3» в демонстрационной версии IBM Watson TTS).